Werden Frauen für KI Nutzung bestraft?

Der verborgene Rufschaden, soziale Stigmatisierung und Bias innerhalb der KI

Künstliche Intelligenz wird zunehmend zur Standard-Schnittstelle für unsere Arbeit.

Sie schreibt E-Mails, fasst Meetings zusammen, entwirft Berichte und hilft Menschen beim Programmieren, Designen und Planen. Aber warum werden Frauen für die KI Nutzung bestraft?

Theoretisch sollte KI ein großer Schritt in Richtung Gleichstellung sein:

- Sie senkt Barrieren zum Fachwissen

- Sie beschleunigt Lernen

- Sie reduziert technische Zugangshürden

Aber eine wachsende Zahl von Studien deutet auf ein komplexes Bild hin.

Das System bestraft Frauen nicht nur dafür, dass sie KI nutzen, sondern auch durch die Ergebnisse, die es selbst produziert.

Und diese Bestrafung geschieht nicht an nur einem Ort.

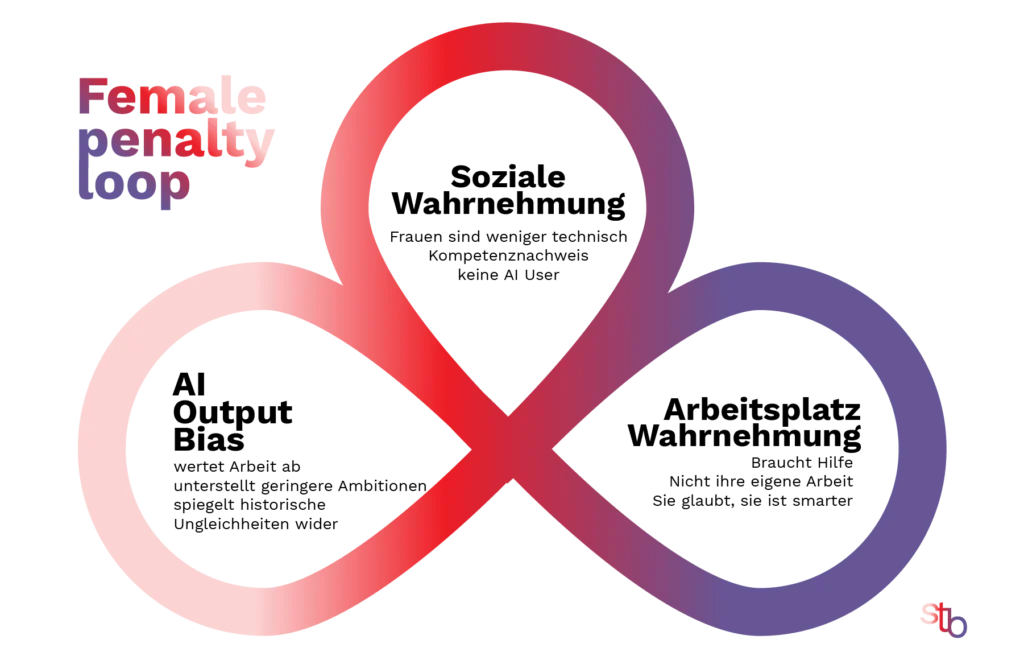

Sie findet in drei sich überschneidenden Schichten statt:

- Rufschaden am Arbeitsplatz

- Soziale Wahrnehmung

- Verzerrungen (Bias) in den KI-Resultaten

Gemeinsam schaffen diese Schichten eine subtile, aber mächtige Schleife — kurz gesagt:

Ja — Frauen werden bestraft, wenn sie KI nutzen.

Schicht 1: Der Rufschaden am Arbeitsplatz

Mehrere aktuelle Studien zeigen, dass Menschen, die KI einsetzen, als weniger kompetent beurteilt werden, selbst wenn das Ergebnis identisch ist. Und zwar nicht nur bei Frauen — dieser Effekt trifft auch Männer.

Aber für Frauen ist dieser Effekt häufig deutlich stärker.

Ein vielzitiertes Forschungspapier beschreibt dies als eine „soziale Bewertungssanktion“ für KI-Nutzung. Menschen erwarten, dass sie als weniger fähig oder weniger motiviert gelten, wenn sie offen sagen, dass sie KI genutzt haben — was die Bereitschaft, KI überhaupt zu benutzen, verringern kann.

Experimentelle Arbeiten deuten darauf hin:

- KI-Nutzer:innen werden als weniger kompetent bewertet

- Die Strafe fällt für Frauen oft stärker aus als für Männer

- Identische Ergebnisse werden je nach Geschlecht unterschiedlich interpretiert

Gleiches Verhalten — unterschiedliche Bedeutung:

| Situation | Mann nutzt KI | Frau nutzt KI |

|---|---|---|

| KI für Bericht | „Effizient und strategisch“ | „Brauchte Hilfe“ |

| KI zum Coden | „Produktivitätsboost“ | „Nicht technisch genug“ |

| KI für Ideen | „Innovativer Denker“ | „Kann nicht selbstständig denken“ |

Dies ist kein neues Vorurteil. Es ist der alte Kompetenz-Doppelstandard — jetzt übertragen auf ein neues Werkzeug.

Frauen sehen sich in vielen Arbeitsumgebungen bereits mit höheren Leitungsnachweisen, weniger Anerkennung für gleiche Leistungen und stärkerer Beobachtung bei Optimierungen konfrontiert. KI wird dann einfach als neues Signal interpretiert, durch das alte Erwartungen bestätigt werden.

Wenn ein Mann KI nutzt: „Er optimiert den Arbeitsablauf.“

Wenn eine Frau KI nutzt: „Sie nimmt Abkürzungen.“

Schicht 2: Das „Authentizitäts-Problem“ & soziale Wahrnehmung

Über Leistungskennzahlen, Produktivitäts-Dashboards und formelle Bewertungen hinaus gibt es eine weitere Schicht, die Karrieren und Selbstvertrauen prägt: soziale Urteile.

KI-Nutzung wird selten als „nur ein weiteres Werkzeug“ wahrgenommen. Stattdessen wird sie moralisiert:

- Ist das Betrug?

- Ist das faul?

- Ist das echte Arbeit?

Diese Fragen spiegeln nicht nur Bedenken über Qualität oder Fairness wider, sondern zeigen etwas Tieferes: unsere kulturellen Erwartungen an Aufwand, Talent und Authentizität — und diese Erwartungen sind nicht geschlechtsneutral.

Kulturelle Erwartungen formen Wahrnehmung:

Für Männer kann KI-Nutzung bedeuten:

- „Er optimiert.“

- „Er nutzt Tools gut.“

- „Er ist technisch versiert.“

Für Frauen hingegen kann es heißen:

- „Sie täuscht etwas vor.“

- „Das ist nicht wirklich ihre Leistung.“

- „Sie gibt vor, klüger zu sein.“

Das zeigt ein tiefer liegendes Muster:

Männer werden stärker nach Leistung beurteilt, Frauen stärker nach Authentizität.

Wenn eine Frau KI nutzt, wird es oft als Verstoß gegen die Erwartung an Natürlichkeit interpretiert. Wenn ein Mann KI nutzt, bestätigt es eher das stereotype Bild des effizienten Problemlösers.

Gleiche Handlung — unterschiedliche Bedeutung.

Schicht 3: Output-Bias — wenn KI selbst Frauen benachteiligt

Die dritte Schicht steckt in den Systemen selbst.

KI-Modelle lernen aus historischen Daten, Internettexten, institutionellen Aufzeichnungen und früheren Entscheidungen, alles Bereiche, in denen reale geschlechtsspezifische Ungleichheiten existieren. Das Ergebnis? KI kann diese Ungleichheiten reflektieren, normalisieren oder subtil verstärken — was für Frauen problematisch ist.

Ein reales Beispiel: Gesundheit und Pflege

Eine Studie aus England fand, dass KI-Tools, die von kommunalen Behörden verwendet werden, Frauen in identischen Fällen schlechter bewerteten als Männer, allein weil das Geschlecht geändert wurde.

Weitere häufig berichtete Muster:

- Niedrigere Gehaltsvorschläge für Frauen

- Risikoscheuere Karriereempfehlungen

- Unterschiedliche Sprache bei Führungsqualitäten

- Weniger starke Beschreibungen von Frauenleistungen

Selbst wenn menschliche Bewerter fair sind, kann die KI-Ausgabe bereits eine Verzerrung (Bias) erzeugen, bevor die Bewertung überhaupt stattfindet.

Ja — Frauen werden für KI Nutzung bestraft

KI schafft keine neuen geschlechtsspezifischen Vorurteile —

sie gibt alten Vorurteilen eine neue Oberfläche.

Und da KI zunehmend das primäre Medium für Arbeit wird, sind ihre Effekte größer, schneller und schwerer erkennbar als je zuvor.

Aber KI könnte Frauen mehr helfen als Männern

Hier kommt die überraschende Kehrseite:

Einige Studien legen nahe, dass KI:

- Personen mit geringem Selbstvertrauen stärker unterstützt

- Fähigkeitslücken in bestimmten Aufgaben reduziert

- Zugang zu Fachwissen demokratisiert

Das bedeutet, dass KI das Spielfeld tatsächlich egalisieren, Karrieren beschleunigen und Barrieren abbauen könnte — aber nur, wenn ihre Nutzung nicht stigmatisiert wird, KI-Ergebnisse fair sind und Arbeitsplätze den Umgang mit KI normalisieren.

Andernfalls hebt der soziale Preis die technischen Vorteile wieder auf.

Referenzen (Englisch):

Women Who Use AI At Work Face A Predictable ‘Competence Penalty’

Women Are Judged Twice as Hard for Using AI

When an AI algorithm is labeled ‚female,‘ people are more likely to exploit it

AI chatbots might be sabotaging women by advising them to ask for lower salaries, study says

Women Are Avoiding AI. Will Their Careers Suffer?

Das könnte dir auch gefallen:

10 Schritte, um KI weiblicher zu machen

Frauen und Künstliche Intelligenz: So gestalten wir die Zukunft mit